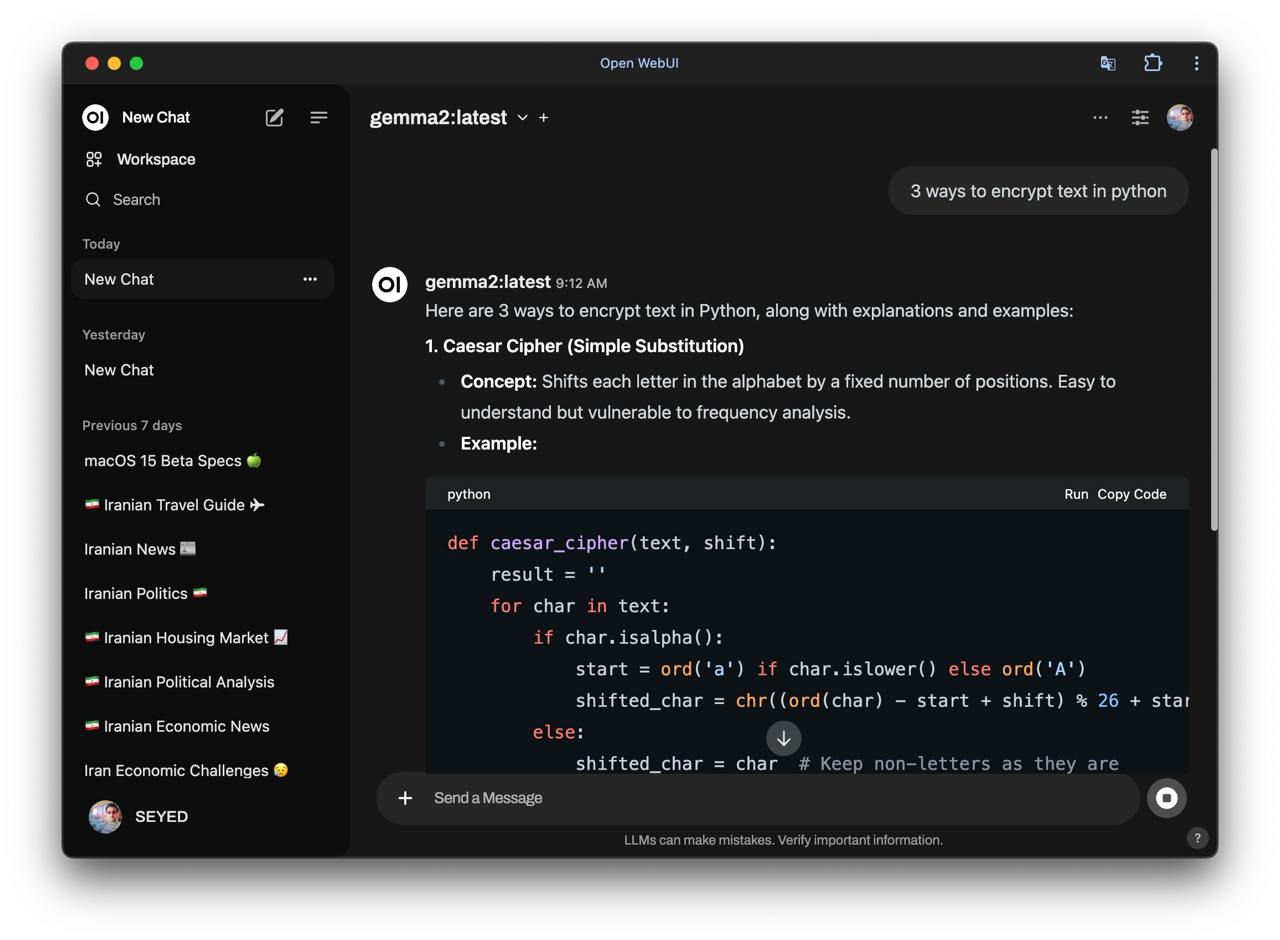

برای مثال من در حال حاضر از gemma 2 که مدل ۲۷ میلیارد پارامتری هست استفاده میکنم روی لوکال

چطور میتونید مدل های هوش مصنوعی رو روی لوکال نصب بکنید ؟

۱- دانلود ollama از اینجا :

https://github.com/ollama/ollama/releases

۲- یکی از مدل هارو انتخاب کنید از اینجا :

برای مثال مدل ۸ میلیارد پارامتری llama 3.1 رو توی این بخش میتونید ببینید :

https://ollama.com/library/llama3.1

برای نصبش بعد از نصب ollama در مرحله ۱ میتونید کامند زیر رو توی ترمنیال بزنید :

ollama run llama3.1

مدلش دانلود میشه و میاد بالا میتونید توی ترمینال باهاش حرف بزنید اما برای اینکه یک اینترفیس وب مثل من داشته باشید داکر رو نصب کنید و بعد این اینترفیس رو طبق توضیحات گیتهابش نصب کنید :

https://github.com/open-webui/open-webui

تبریک، الان شما یک مدل هوش مصنوعی به صورت لوکال دارید.